- Main

- Computers - Computer Science

- Strengthening Deep Neural Networks:...

Strengthening Deep Neural Networks: Making AI Less Susceptible to Adversarial Trickery

Katy WarrНаскільки Вам сподобалась ця книга?

Яка якість завантаженого файлу?

Скачайте книгу, щоб оцінити її якість

Яка якість скачаних файлів?

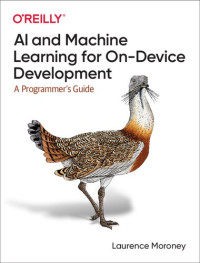

As deep neural networks (DNNs) become increasingly common in real-world applications, the potential to deliberately "fool" them with data that wouldn’t trick a human presents a new attack vector. This practical book examines real-world scenarios where DNNs—the algorithms intrinsic to much of AI—are used daily to process image, audio, and video data.

Author Katy Warr considers attack motivations, the risks posed by this adversarial input, and methods for increasing AI robustness to these attacks. If you’re a data scientist developing DNN algorithms, a security architect interested in how to make AI systems more resilient to attack, or someone fascinated by the differences between artificial and biological perception, this book is for you.

• Delve into DNNs and discover how they could be tricked by adversarial input

• Investigate methods used to generate adversarial input capable of fooling DNNs

• Explore real-world scenarios and model the adversarial threat

• Evaluate neural network robustness; learn methods to increase resilience of AI systems to adversarial data

• Examine some ways in which AI might become better at mimicking human perception in years to come

Author Katy Warr considers attack motivations, the risks posed by this adversarial input, and methods for increasing AI robustness to these attacks. If you’re a data scientist developing DNN algorithms, a security architect interested in how to make AI systems more resilient to attack, or someone fascinated by the differences between artificial and biological perception, this book is for you.

• Delve into DNNs and discover how they could be tricked by adversarial input

• Investigate methods used to generate adversarial input capable of fooling DNNs

• Explore real-world scenarios and model the adversarial threat

• Evaluate neural network robustness; learn methods to increase resilience of AI systems to adversarial data

• Examine some ways in which AI might become better at mimicking human perception in years to come

Категорії:

Рік:

2019

Видання:

1

Видавництво:

O’Reilly Media

Мова:

english

Сторінки:

246

ISBN 10:

1492044954

ISBN 13:

9781492044956

Файл:

PDF, 32.55 MB

Ваші теги:

IPFS:

CID , CID Blake2b

english, 2019

Напротязі 1-5 хвилин файл буде доставлено на ваш email.

Напротязі 1-5 хвилин файл буде доставлено на ваш Telegram акаунт.

Увага: переконайтесь, що ви прив'язали свій акаунт до Z-Library Telegram боту.

Напртязі 1-5 хвилин файл буде доставлений на ваш Kindle пристрій.

Примітки: вам необхідно верифікувати кожну книгу, яку Ви надсилаєте на Kindle. Перевірте Вашу електронну скриньку на наявність листів з підтвердженням від Amazon Kindle Support.

Виконується конвертація в

Конвертація в не вдалась

Переваги Преміум статусу

- Надсилайте на електронні читалки

- Ліміт завантажень збільшений

Конвертуйте файли

Конвертуйте файли Більше результатів пошуку

Більше результатів пошуку Інші переваги

Інші переваги

Ключові фрази

Пов’язані вибірки

Amazon

Amazon  Barnes & Noble

Barnes & Noble  Bookshop.org

Bookshop.org